Sztuczna inteligencja (AI) to temat, który zyskuje na znaczeniu w niemal każdej branży. Integracja AI z systemami zarządzania staje się jednym z kluczowych obszarów, w którym organizacje widzą ogromny potencjał. Dzięki automatyzacji procesów, lepszej analizie danych i optymalizacji decyzji, AI wprowadza rewolucję w zarządzaniu. Jednak z każdą nową technologią pojawiają się również ryzyka. W kontekście AI, szczególna uwaga jest zwrócona na normy regulujące jej zastosowanie oraz na audyty, które pozwalają zapewnić bezpieczeństwo i zgodność z wymaganiami.

Spis treści

Wyzwania związane z integracją AI w systemy zarządzania

Integracja AI w systemach zarządzania to proces pełen wyzwań, ale także wielkich korzyści. Z jednej strony, technologia ta umożliwia automatyzację wielu procesów, co może znacznie zwiększyć efektywność organizacji. Z drugiej strony, pojawia się ryzyko związane z błędami algorytmów, nieodpowiednią jakością danych, a także potencjalnymi problemami związanymi z prywatnością i bezpieczeństwem.

Przykładem mogą być systemy podejmujące decyzje w zakresie kredytowania w bankach, w których AI decyduje, komu przyznać pożyczkę. Błąd w algorytmie może prowadzić do nieuczciwego traktowania klientów lub błędnych decyzji kredytowych. Również w obszarze produkcji AI może decydować o jakości produktów, a jakiekolwiek nieprawidłowości mogą prowadzić do wadliwych wyrobów i problemów z bezpieczeństwem.

Najważniejsze wyzwanie, przed którym stoją organizacje, to zarządzanie ryzykiem związanym z AI. Algorytmy są tylko tak dobre, jak dane, na których są trenowane, a także mechanizmy, które umożliwiają ich nadzór. Istnieje również ryzyko, że AI podejmie błędne decyzje, które mają dalekosiężne konsekwencje dla organizacji.

Normy dotyczące AI w systemach zarządzania

Zarządzanie ryzykiem związanym z AI nie jest możliwe bez przestrzegania odpowiednich norm i regulacji. Istnieje wiele standardów międzynarodowych, które regulują kwestie związane z bezpieczeństwem, jakością i przejrzystością systemów sztucznej inteligencji.

ISO/IEC 27001:2013 jest podstawową normą w kontekście zarządzania bezpieczeństwem informacji. Zastosowanie tej normy w kontekście AI oznacza, że organizacje muszą zapewnić odpowiednią ochronę danych wykorzystywanych do treningu algorytmów AI. Zgodność z tą normą pozwala na zabezpieczenie informacji przed nieautoryzowanym dostępem, co jest kluczowe w przypadku systemów działających na danych osobowych.

ISO/IEC 9001:2015, z kolei, dotyczy systemów zarządzania jakością. Dotyczy to również jakości procesów związanych z tworzeniem i wdrażaniem technologii AI. Firmy, które decydują się na wdrożenie AI, muszą zapewnić, że ich rozwiązania są zgodne z normami jakości, a procesy związane z ich wdrożeniem i zarządzaniem są odpowiednio monitorowane.

Dodatkowo, ISO/IEC JTC 1/SC 42, czyli normy dotyczące sztucznej inteligencji, obejmują szeroki zakres zagadnień związanych z odpowiedzialnym rozwojem AI. Te normy pomagają firmom tworzyć i wdrażać technologie AI, które są transparentne, etyczne i bezpieczne. Uwzględniają także kwestie związane z odpowiedzialnością za podejmowane decyzje oraz zapewniają, że systemy AI działają zgodnie z obowiązującymi przepisami.

Audyt AI – jak wygląda proces audytowania systemów sztucznej inteligencji?

Audyt AI to proces, który pozwala firmom ocenić, czy ich systemy AI działają zgodnie z wymaganiami norm i regulacji, a także czy są efektywne i bezpieczne. Proces audytu AI jest niezbędny, aby organizacje mogły monitorować działanie systemów AI, identyfikować ryzyka oraz zapewnić zgodność z przepisami prawnymi.

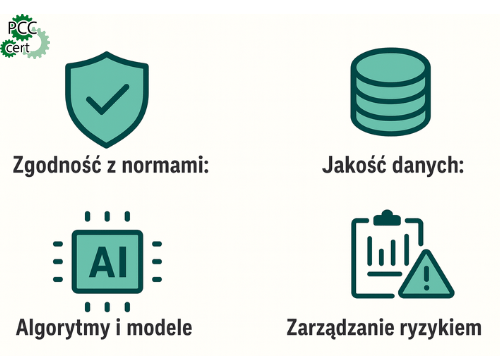

Podczas audytu AI, przeanalizowane zostaną takie aspekty jak:

Zgodność z normami: Czy system AI jest zgodny z międzynarodowymi normami bezpieczeństwa informacji (np. ISO/IEC 27001) oraz normami jakości (np. ISO/IEC 9001)?

Jakość danych: Jakie dane są wykorzystywane do trenowania algorytmów AI? Czy są one wystarczająco reprezentatywne i aktualne?

Algorytmy i modele: Jakie algorytmy i modele AI są wykorzystywane? Jak są one testowane pod kątem efektywności i bezpieczeństwa?

Zarządzanie ryzykiem: Jakie mechanizmy są stosowane w celu monitorowania działania systemów AI oraz zapobiegania potencjalnym ryzykom, takim jak błędne decyzje czy zagrożenia bezpieczeństwa?

W wyniku audytu organizacja otrzymuje raport z zaleceniami, które pozwalają na usprawnienie funkcjonowania systemów AI oraz zapewnienie ich zgodności z wymaganiami norm.

Podsumowanie

Integracja AI w systemach zarządzania to temat, który zyskuje na znaczeniu, ale wiąże się również z szeregiem ryzyk. Odpowiednie zarządzanie tymi ryzykami, przestrzeganie norm i przeprowadzanie audytów AI to kluczowe elementy, które pozwalają na skuteczne i bezpieczne wykorzystanie sztucznej inteligencji w biznesie. Firmy muszą zadbać o to, aby ich systemy AI były zgodne z normami, monitorowane i audytowane, aby uniknąć błędów oraz zapewnić bezpieczeństwo danych i procesów.